Искусственный интеллект и мозг: исследование показывает удивительное сходство в распознавании языка. Источник: AI

Пока мы спорим, заменит ли искусственный интеллект человека, ученые из Колумбийского университета (Columbia University) и IBM Research выяснили, что мы давно работаем по схожим схемам. По крайней мере, когда речь идет о распознавании языка. Исследователи сравнили внутренние состояния рекуррентных нейросетей (RNN) с активностью мозга живых людей и обнаружили удивительное сходство, которое намекает: природа и математика пришли к одному и тому же эффективному решению независимо друг от друга.

Эксперимент на открытом мозге

Для этого исследования ученым понадобилось нечто большее, чем просто МРТ-сканер. Они привлекли 15 пациентов с эпилепсией, которым по медицинским показаниям уже были имплантированы электроды непосредственно в слуховую кору. Это позволило фиксировать электрическую активность нейронов с точностью, недоступной для внешних датчиков. Пациенты в течение 30 минут слушали рассказы, пока ученые записывали реакцию их мозга.

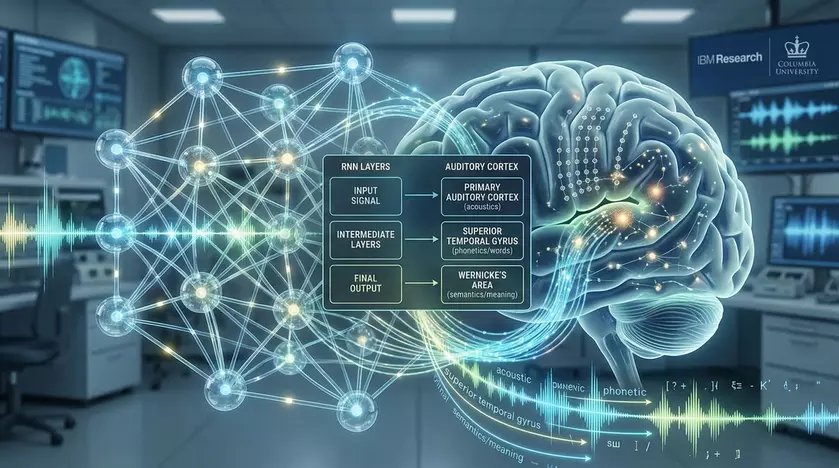

Параллельно ту же аудиодорожку «скармливали» рекуррентной нейросети, обученной распознавать язык. IBM Research и их коллеги анализировали, как меняется информация на каждом этапе – от входного сигнала до финального понимания смысла. Оказалось, что обе системы проходят почти идентичную иерархическую лестницу: сначала выделяются базовые акустические признаки, затем фонетические элементы, далее слова и, наконец, сложные смысловые конструкции.

От вибраций к философии

Важный аспект состоит в том, что по мере продвижения слоями нейросети информация топографически соответствовала иерархии обработки в коре человека. То есть начальные слои ИИ коррелировали с первичной слуховой зоной, а более глубокие – с областями, отвечающими за понимание языка. Это свидетельствует о том, что оптимальный путь от «шума в ушах» до «идеи в голове» – штука достаточно универсальная.

Интересно, что такое сходство возникало только тогда, когда алгоритм учился на конкретном языке. Как и человеческий мозг, осваивающий родной язык, ИИ структурирует свои знания в зависимости от лингвистического контекста. Если подсунуть сети, обученной английскому, китайский – магии не произойдет. Это еще раз подчеркивает, что мы имеем дело не просто с математическим совпадением, а с фундаментальным принципом обработки речевой информации.

Почему старая добрая рекурентность лучше трансформеров

Авторы работы особо подчеркнули, что для сравнения выбрали именно RNN (Recurrent Neural Networks), а не современные трансформеры, на которых базируются популярные чат-боты. Современные архитектуры часто обрабатывают текст или звук целыми блоками, видя все сразу. Мозг так не умеет – он обрабатывает поток информации последовательно, шаг за шагом. Именно поэтапность RNN позволила провести прямые параллели с биологическими процессами.

Это исследование открывает двери для использования ИИ в качестве «прозрачной модели» мозга. Вместо того чтобы проводить сложные инвазивные операции на людях, ученые смогут тестировать гипотезы на нейросетях, работающих по схожим принципам. Однако остаются вопросы без ответов. Например, почему человеческий язык асимметричный и «живет» преимущественно в левом полушарии, тогда как ИИ обычно не демонстрирует такой специализации зон. В будущем ученые планируют выяснить, как мозг и алгоритмы справляются со вторым языком и можно ли с помощью этих моделей лечить нарушение речи.

Пока одни компании пытаются научить алгоритмы думать, другие, например Meta, заключают соглашения с медиа, чтобы просто сделать ответы своих моделей более точными и человечными за счет качественных данных.